Моя мама начала терять слух, когда я учился в колледже. Я возвращался домой, чтобы поделиться знаниями, которые я получил, и она наклонилась, чтобы услышать меня. Вскоре ей стало трудно вести разговор, если одновременно разговаривали более одного человека. И даже со слуховым аппаратом она все равно изо всех сил пытается различать голоса собеседников. Когда я со своей семьей приезжаем на ужин, она все еще просит нас поговорить по очереди.

Об авторе: ДэЛян Ванг, профессор кафедры компьютерных наук и инженерии, сотрудник Центра изучения мозга и когнитивных наук Университета штата Огайо в Коламбусе. Руководит лабораторией восприятия и нейродинамики, которая занимается разработкой алгоритмов для решения проблем, связанных с машинным восприятием. Ванг получил докторскую степень в области компьютерных наук в Университете Южной Калифорнии в Лос-Анджелесе в 1991 году после защиты степеней бакалавра и магистра в Пекинском университете. Является главным редактором журнала [Neural Networks].

Наконец, пользователи слуховых аппаратов могут слышать речь в переполненной комнате

Трудности с которыми столкнулась моя мама, являются классической проблемой для производителей слуховых аппаратов. Слуховая система человека может естественным образом распознавать голос в переполненной комнате, но создание слухового аппарата, имитирующего эту способность, ставит в тупик специалистов по обработке сигналов, экспертов по искусственному интеллекту и аудиологов на протяжении десятилетий. Британский ученый Колин Черри впервые назвал это «проблемой вечеринки» в 1953 году.

Спустя более шести десятилетий, только 25 процентов людей, которые нуждаются в слуховом аппарате пользуются им. Наибольшее разочарование среди пользователей заключается в том, что слуховой аппарат не может различить, например, голос человека и звук проезжающей машины, когда эти звуки возникают одновременно. Устройство увеличивает громкость всех звуков и человека и машины, создавая бессвязный гул.

Пришло время решить эту проблему. Чтобы улучшить восприятие слуховых аппаратов, лаборатория в Университете штата Огайо в Колумбусе применила машинное обучение, основанное на глубоких нейронных сетях, для разделения звуков. В лаборатории протестировали несколько версий цифровой обработки, которая не только усиливает звук, но также может распознавать и разделять речь от фонового шума и автоматически регулировать их громкость в отдельности.

“Мы считаем, что этот подход может в конечном итоге восстановить понимание звуков у человека с нарушениями слуха, чтобы оно соответствовало или даже превосходило понимание человека с нормальным слухом. Нам удалось повысить, с 10 до 90 процентов, способность некоторых субъектов понимать произнесенные слова, затененные шумом. Поскольку слушателям не обязательно понимать каждое слово в фразе, чтобы понять ее значение, эта способность показала разницу между пониманием предложения и нет.”

Без хорошего слухового аппарата восприятие звуков в мире станет хуже. По оценкам Всемирной организации здравоохранения, 15 процентов взрослых, или примерно 360 миллионов человек, страдают потерей слуха . Это число растет по мере роста населения и увеличения доли пожилых людей. И потенциальный рынок для продвинутых слуховых аппаратов не ограничен людьми с потерей слуха. Разработчики могут использовать эти устройства для улучшения распознавания речи смартфона. Работодатели могли бы использовать их, чтобы помочь рабочим на шумных заводах, а военные могли бы вооружать ими солдат, чтобы они могли слышать друг друга сквозь шумный хаос войны.

Без хорошего слухового аппарата восприятие звуков в мире станет хуже. По оценкам Всемирной организации здравоохранения, 15 процентов взрослых, или примерно 360 миллионов человек, страдают потерей слуха . Это число растет по мере роста населения и увеличения доли пожилых людей. И потенциальный рынок для продвинутых слуховых аппаратов не ограничен людьми с потерей слуха. Разработчики могут использовать эти устройства для улучшения распознавания речи смартфона. Работодатели могли бы использовать их, чтобы помочь рабочим на шумных заводах, а военные могли бы вооружать ими солдат, чтобы они могли слышать друг друга сквозь шумный хаос войны.

Все это дает большие возможности для сбыта. Согласно прогнозу исследовательской фирмы MarketsandMarkets в Пуне, Индия, мировая индустрия слуховых аппаратов с годовым оборотом в 6 миллиардов долларов США будет расти на 6 процентов каждый год до 2020 года. Удовлетворение всех новых пользователей, предполагает поиск способа оставить проблему с распознаванием речи в шуме, позади нас. В конце концов, исследование на глубоких нейронных сетях указывает путь вперед.

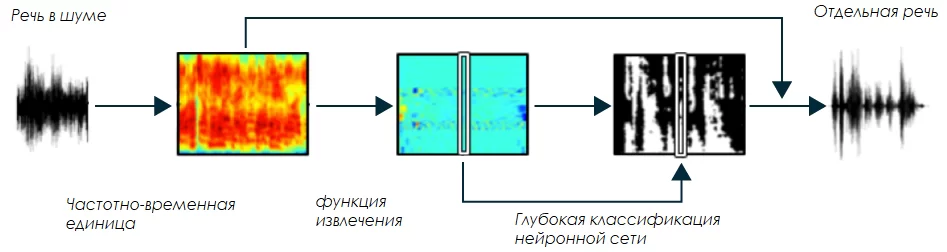

Чтобы отделить речь от шума, программа машинного обучения разбивает шумную речь на набор элементов, называемых частотно-временными единицами. Затем анализирует эти единицы, чтобы выделить 85 функций, которые отличают речь от других звуков. Затем программа передает функции в глубокую нейронную сеть, которая классифицирует единицы как речевые или не основанные на подобных образцах. Наконец, программа применяет цифровую обработку, которая отбрасывает все неречевые единицы, чтобы оставить только разделенную речь.

В течение десятилетий инженеры-электрики и компьютерщики пытались и не смогли добиться выделения речи с помощью обработки сигналов. Наиболее популярным подходом было использование детектора голосовой активности для выявления паузы между высказываниями людей во время их речи. При таком подходе система определяет звуки, захваченные в этих промежутках, как «шум». Затем алгоритм вычитает шум из исходной записи, оставляя идеальную речь без помех.

К сожалению, этот метод, известный как спектральное вычитание , плох тем, что удаляет слишком много речи или слишком мало шума. Часто в результате получается неприятный, так называемый музыкальный шум, из-за которого звук звучит так, как если бы он был записан под водой. Проблемы настолько серьезны, что даже после многих лет разработки этот метод ничего не делает для улучшения способности людей распознавать речь в шумной обстановке.

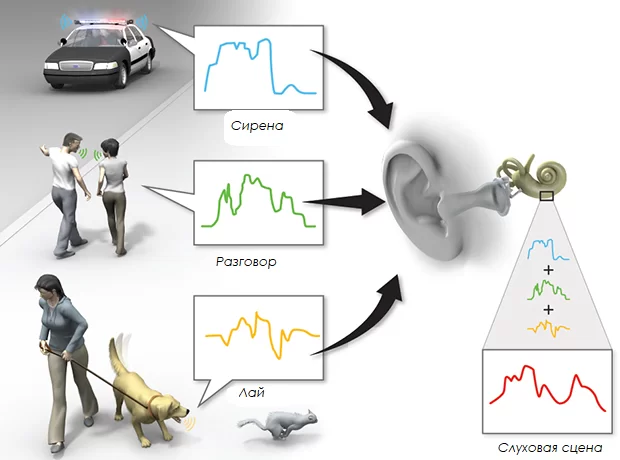

Мы поняли, что мы должны использовать другой подход. Мы начали с теории Альберта Брегмана, психолога из Университета Макгилла в Монреале, Канада, который в 1990 году предположил, что слуховая система человека преобразовывает звуки в отдельные потоки. Каждый поток соответствует звуку, исходящему из одного источника, например, голос собеседника. Каждый звуковой поток уникален по высоте, громкости и направлению, из которого он идет.

Отчасти благодаря своей странной форме человеческое ухо захватывает много звуковых потоков одновременно. Поток — это все звуковые волны, которые исходят от одного источника, например, такого как собака. Вместе эти потоки составляют слуховую сцену (лай + сирена + разговоры).

В целом, многие потоки, такие как голос собеседника, говорящего под рев хоккейной игры, составляют то, что Брегман называет «слуховой сценой». Если звуки используют одну и ту же полосу частот в одно и то же время, и самый громкий звук в сцене подавляет другие — это полезный принцип, известный как слуховое маскирование. Например, кто-то может не услышать тиканье часов в углу комнаты, если дождь стучит по крыше. Этот принцип, также используется в формате MP3 для сжатия файлов до одной десятой от их первоначального размера путем удаления замаскированных звуков (например, тиканье часов в данном случае), при этом пользователи не замечают это упущение.

Анализируя работу Брегмана, мы задавались вопросом, возможно ли создать фильтр для того, чтобы определить доминирует ли один звуковой поток над другими в данный момент в определенной частотной полосе. Специалисты по психоакустике, которые занимаются изучением звукового восприятия, делят средний слуховой диапазон на две дюжины полос от 20 Гц до 20 000 Гц. Мы хотели создать фильтр, который бы показал, какой звуковой поток, содержащий речь или шум, был более сильным в определенные моменты времени в этих полосах, как первый шаг к их разделению.

Моя лаборатория была первой, которая в 2001 году разработала такой фильтр, который отмечает звуковые потоки, в которых преобладает речь или шум. С помощью этого фильтра мы позже разработаем программу машинного обучения, которая будет отделять речь от других звуков на основе нескольких отличительных признаков, таких как амплитуда (громкость), гармоническая структура (конкретное расположение тонов) и начало (когда начинается конкретный звук по отношению к другим).

Мы назвали этот новый фильтр — идеальной бинарной маской. Он маркирует шум и речь, которые он находит в сегментах звука, называемых частотно-временными единицами, которые обозначают определенный короткий интервал в пределах определенной частотной полосы. Фильтр анализирует каждую частотно-временную единицу в выборке из зашумленной речи и помечает каждую из них как 1 или 0. Он добавляет 1, если «целевой» звук (в данном случае речь) громче шума, и 0, если целевой звук тише, мягче. Результатом является набор из 1 и 0, которые показывают преобладание шума или речи в выборке. Затем фильтр отбрасывает все блоки, обозначенные 0 и реконструирует речь из тех, что набрали 1. Для восстановления понятного предложения из зашумленной речи определенный процент частотно-временных единиц должен быть отмечен как 1.

Мы начали тестировать бинарную маску в 2006 году в исследовательской лаборатории ВВС США в Огайо. Примерно в то же время, команда из Сиракузского университета в Нью-Йорке самостоятельно оценили бинарную маску. В этих исследованиях фильтр помогал людям с нарушениями слуха, а также людям с нормальным слухом лучше понимать предложения, смешанные с шумом.

Мы создали речевой фильтр, который работал безупречно в лаборатории. Но у этого фильтра есть нереальное преимущество. Мы представили его с образцами речи и шума отдельно и затем испытывали его с помощью смесей тех же образцов. Поскольку ему были даны ответы (поэтому он «идеален»), фильтр знал, когда речь была громче фонового шума. На практике речевой фильтр должен сам по себе и на лету отделять голос от шума в комнате.

Тем не менее, тот факт, что идеальная бинарная маска значительно улучшает понимание речи как для людей с нарушениями слуха, так и для людей с нормальным слухом, имеет глубокий смысл. Он показал, что методика классификации, формат контролируемого обучения, может быть использована для аппроксимации идеальной бинарной маски, как способ выделения речи от шума. Путем классификации звуков машина имитирует человеческий слух. В результате машина может выполнять различные упражнения, запоминать результаты, получать обратную связь и накапливать опыт. По сути, это то же самое, что и, то как люди с юных лет учатся различать яблоки от апельсин, хотя и то и другое фрукт.

В последующие годы моя лаборатория предприняла первую попытку приблизиться к идеальной бинарной маске с помощью метода классификации. Примерно в то же время, когда мы разрабатывали наш звуковой классификатор, группа из Университета Карнеги-Меллона в Питтсбурге, разработала собственный метод, основанный на машинном обучении, для классификации частотно-временных единиц с другой целью: улучшить автоматическое распознавание речи. Позже группа в Университете Техаса в Далласе во главе с покойным Филиппом Лойзу использовала другой метод классификации. Он стал первым, кто продемонстрировал значимое улучшение разборчивости речи для людей с нормальным слухом, полагаясь только на монофонические особенности (в отличие от бинауральных, запечатленных двумя ушами).

Но эти ранние методы классификации не были достаточно мощными или точными, чтобы помочь пользователям слуховых аппаратов. Они не могли справиться со сложной и непредсказуемой смесью шумов и голосов, которые происходят в мире. Для этого понадобится нечто гораздо более мощное.

Показав многообещающие первые результаты с нашими ранними методами классификации, мы решили сделать следующий шаг, улучшить систему таким образом, чтобы она могла работать в шумных реальных условиях. Мы решили попытаться сделать то, чего никогда не делали раньше: создать программу машинного обучения, которая будет работать в нейронной сети и отделять речь от шума после прохождения сложного процесса обучения. Программа будет использовать идеальную бинарную маску для обучения нейронной сети. И это сработало. В исследовании с участием 24 испытуемых мы продемонстрировали, что эта программа может повысить понимание речи у людей с нарушениями слуха примерно на 50 процентов.

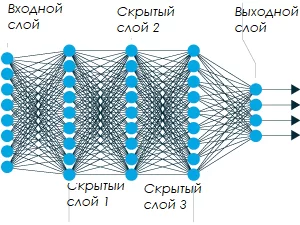

По сути, нейронная сеть — это программная система, построенная из относительно простых элементов, которые могут достигать сложных уровней обработки, задействовав все свои элементы. (Структура системы работает на примере того, как нейроны и их сети работают в головном мозге.) Сталкиваясь с новыми примерами, нейронные сети, как человеческий мозг, могут «научиться», определять значимость связей между разными элементами.

По сути, нейронная сеть — это программная система, построенная из относительно простых элементов, которые могут достигать сложных уровней обработки, задействовав все свои элементы. (Структура системы работает на примере того, как нейроны и их сети работают в головном мозге.) Сталкиваясь с новыми примерами, нейронные сети, как человеческий мозг, могут «научиться», определять значимость связей между разными элементами.

Нейронные сети бывают разных форм и размеров и с различной степенью сложности. Глубокие (многослойные) нейронные сети имеют как минимум два «скрытых» слоя обработки, которые не связаны напрямую со входным и выходным слоем. Каждый скрытый слой улучшает результаты, подаваемые к нему предыдущими слоями, основываясь на ранее полученных знаниях.

Например, программа, предназначенная для проверки подписи клиента, может начинаться со сравнения новой подписи с образцом, включенным в учебную базу данных. Однако в программу заложено, что новая подпись не должна точно соответствовать оригиналу. Другой слой обработки может определять, имеет ли новая подпись определенные качества, которые остаются неизменными в подписи человека, например, такие как угол наклона или особенность не ставить точку на букве i.

Чтобы построить собственную глубокую нейронную сеть, мы начали с написания алгоритмов для выделения функций, которые могли бы отличать голоса от шума на основе общих изменений громкости, частоты и модуляции каждого из них. Мы определили десятки свойств, которые могли бы помочь нашей программе различать речь и шум, и мы использовали 85 из них, чтобы сделать алгоритмы максимально эффективными и мощными. Среди наиболее важных свойств, которые мы определили, были частоты звуков и их интенсивность (громкая или тихая).

Затем мы обучили глубокую нейронную сеть использовать эти 85 свойств, чтобы отличать речь от шума. Это обучение проходило в два этапа: во-первых, мы устанавливаем параметры программы с помощью обучения без учителя. Мы заложили в программу множество примеров различных свойств, чтобы подготовить ее к видам сигналов, которые впоследствии нужно будет распознавать автоматически.

Второй этап, заключался в контроле обучения. Мы использовали образцы шумной речи и соответствующие им результаты на идеальной бинарной маске. В частности, набор 1 и 0, которые составляют идеальную бинарную маску, был похож на лист ответов, который мы использовали для тестирования и улучшения способности нашей программы отделять речь от шума. Для каждого нового образца программа определяла набор признаков, характерных речи или шуму. Затем, после анализа этих признаков — частот, интенсивностей и т. д. — фильтр выполняет предварительную классификацию — это была речь или это был шум? — и сравнивает результат с тем, что был получен идеальной бинарной маской. Если результат сильно отличался от той последовательности нулей и единиц, которую мы получили с использованием бинарной маски, мы соответствующим образом перенастраивали параметры нейронной сети.

Чтобы внести эти корректировки, мы сначала рассчитали расхождения между результатом полученным от нейронной сети, и результатом, полученным от бинарной маски. Как только мы вычислили ошибку, мы использовали соотношения между частями нейронной сети, чтобы в случае повторного выполнения той же классификации расхождение уменьшилось. Обучение нейронной сети состоит в выполнении этой процедуры сотни и тысячи раз.

Одним из важных усовершенствований на этом пути было создание второй глубокой нейронной сети, которая получает результаты первой, и улучшает их. В то время как эта первая сеть была сосредоточена на маркировке атрибутов в каждой отдельной взятой частотно-временной единице, вторая сеть будет проверять признаки ближайших прилегающих к первой единиц. Чтобы понять принцип этой работы, приведем пример: если первая сеть была похожа на человека, который осматривает дом на продажу внутри, вторая сеть походила на человека, который осматривал прилегающую территорию. Другими словами, вторая сеть предоставила первой сети дополнительную информацию о речи и шуме, которые она обрабатывала, и дополнительно улучшила точность классификации. Например, слог может длиться много частотно-временных единиц, а фоновый шум может резко измениться во время разговора.

В конце контролируемого обучения классификатор глубинных нейронных сетей оказался намного лучше, чем более ранние методы отделения речи от шума. Фактически, этот алгоритм был первым из моноуральных технологий, который значительно улучшил способности слушателей с нарушениями слуха понимать смысл произносимых фраз, на фоне шума.

Чтобы проверить это вживую, мы попросили 12 людей с нарушениями слуха и 12 людей с нормальным слухом прослушать записи речи на фоне различных шумов. Записи было парные: сначала речь и шум вместе, а затем та же запись после обработки нашей программой, работающей на глубоких нейронных сетях. Предложения, которые включали в себя такие фразы, как «здесь становится холодно» и «они ели лимонный пирог», были заглушены двумя типами шума — постоянным гудящим шумом и бормотанием толпы людей, говорящих одновременно. Устойчивый шум был похож на звук работающего холодильника, в котором звуковые волны повторяются, а форма частотного спектра не изменяется с течением времени. Мы создали шумную фоновую завесу, добавив голоса четырех мужчин и четырех женщин, чтобы имитировать “коктейльную вечеринку”.

Люди в обеих группах продемонстрировали значительное улучшение способности понимать речь на фоне шума после того, как речь была обработана нашей программой. Люди с нарушениями слуха смогли понять только 29 процентов слов, окутанных болтовней, без программы, но они поняли 84 процента после обработки. Некоторые из них начали от понимания только 10 процентов слов в исходном образце до понимания примерно 90 процентов с программой. С постоянным шумом были аналогичные результаты у людей с нарушениями слуха — распознавание выросло с 36 до 82 процентов.

Даже люди с нормальным слухом смогли лучше понять речь в шуме, а это значит, что наша программа может помочь гораздо большему количеству людей, чем мы изначально предполагали. Слушатели с нормальным слухом понимали 37 процентов слов, произнесенных на фоне постоянного шума без программы, и 80 процентов с ней. Что касается восприятия на фоне множества голосов одновременно, результаты улучшились с 42 процентов до 78 процентов.

Один из самых интригующих результатов нашего эксперимента был получен, когда мы решили проверить, смогут ли люди с нарушениями слуха, при помощи нашей программы, превзойти людей с нормальным слухом? Ответ — да. Слушатели с нарушением слуха, которые использовали нашу программу, поняли почти на 20 процентов больше слов в равномерном шуме и примерно на 15 процентов больше слов в многоголосом шуме, чем те, у кого нормальный слух, и которые полагались исключительно на свою собственную слуховую систему. Благодаря этим результатам наша программа, построенная из глубоких нейронных сетей, стала наиболее близкой к решению проблемы “коктейльной вечеринки” из всех возможных на сегодняшний день.

Конечно, существуют ограничения возможностей программы. Например, шум на записях, которые использовались в экспериментах, все еще сильно похож на те шумы, на которых программа училась. Чтобы функционировать в реальной жизни, программе необходимо быстро научиться распознавать многие типы шумов.

Например, звук вентиляции отличается от шума компрессора холодильника. Кроме того, в наших исследованиях, мы не учли эхо от стен и предметов в комнате, что усугубляет проблему “коктейльной вечеринки”.

С тех пор, как мы опубликовали эти ранние результаты, мы приобрели базу данных звуковых эффектов — это 10000 шумов, разработанную для кинематографистов, и использовали ее для дальнейшей подготовки программы. В этом году мы обнаружили, что обновленная программа добилась значительного улучшения понимания речи как для слушателей с нарушениями слуха, так и для слушателей с нормальным слухом. Теперь, благодаря финансированию Национального института глухоты и других проблем коммуникации, мы исследуем программу в новых звуковых средах и тестируем ее с большим количеством слушателей с потерей слуха.

В конце концов, мы считаем, что программу нужно обучать на мощных компьютерах и встроить непосредственно в слуховой аппарат или загружать на смартфоны с возможностью беспроводного соединения, например, Bluetooth, для подачи обработанного сигнала в режиме реального времени в слуховой аппарат. С каждым усовершенствованием программы владельцы слуховых аппаратов могут обновлять свои устройства. Мы подали несколько патентов на эту программу и работаем с партнерами по ее коммерциализации с ведущим производителем слуховых аппаратов в США компанией Starkey Hearing Technologies , в Eden Prairie, Миннесота.

Сегодня «проблема коктейльной вечеринки» выглядит не такой неразрешимой, как еще несколько лет назад. Теперь мы сможем создавать программное обеспечение, которое, в конечном итоге решит эту проблему благодаря более интенсивному обучению в более шумных ситуациях. На самом деле, этот процесс похож на то, как дети учатся распознавать речь среди шума окружающего мира – постоянно находясь среди шума и речи. Накапливая опыт и приходит понимание. В этом вся прелесть метода. Как и в воспитании ребенка — время идет нам на пользу.

Источник: https://spectrum.ieee.org

Комментарий (1)

Очень круто, что нейросети и искусственный интеллект даже в сфере слуховых аппаратов могут быть весьма полезны.

Так, ми самі досі в захваті від цього! Тепер слухові рішення стали справжніми життєвими асистентами!